|

■ ChatGPT夜明け前:人工知能との親密性をめぐる可能性

同志社大学社会学研究科博士後期課程 王婧瑜

1.はじめに

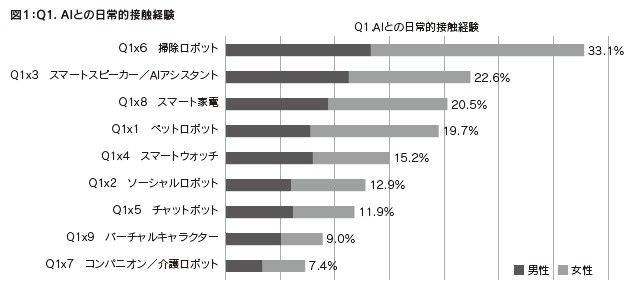

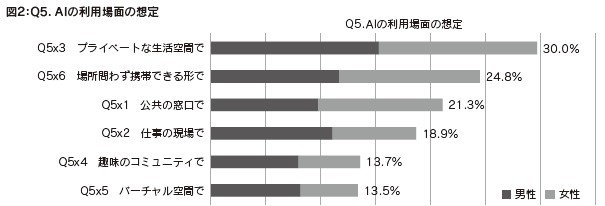

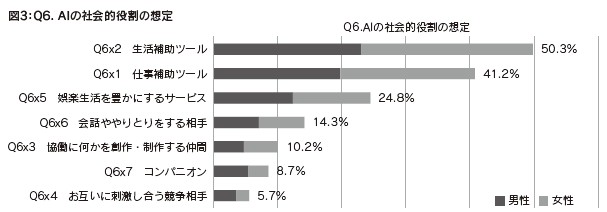

①擬人化された外部機構を有しない「日常道具」:3スマートスピーカー/AIアシスタント、4スマートウォッチ、6掃除ロボット、8スマート家電が該当 ②擬人化された外部機構を有する「人間により近い存在、人間の代替」:1ペットロボット、2ソーシャルロボット、5チャットボット、7コンパニオン/介護ロボット、9バーチャルキャラクターが該当 次にAI技術の日常利用に対する人々の予期や役割の想定を明らかにするため、Q5ではAIの利用場面、Q6では社会的役割に関して回答を求めた。利用場面の想定では、「あてはまるものはない」(37.1%)を除くと「プライベートな生活空間で」(30.0%)が最も多く、次いで「場所を問わず携帯できる形で(携帯電話、スマートウォッチやイアホンのように)」(24.8%)が続いた。(図2 ) 一方、利用場面の想定において「仕事の現場で」は18.9%で第4位にとどまったが、Q6の社会的役割の認識については「仕事を補助するツール」が41.2%と第2位に位置し、利用場面と社会的役割に関する認識の間に差異が垣間見える。最も多く選ばれた役割は「日常生活を補助するツール」(50.3%)であり、AI技術に対する生活支援道具としての期待がうかがえる。(図3)

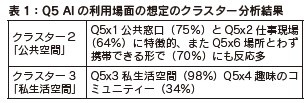

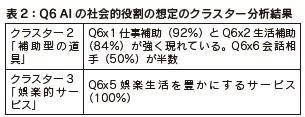

さらに、AI技術の日常利用に関する想定の特徴を明らかにするため、AIの利用場面と社会的役割について各選択肢間の関係性をクラスター分析(k-means法)を用いて検証する。利用場面や社会的役割についての認識の分化を明らかにするためである。特徴のある2つのクラスターは表1に示す通りだった(表1と表2が示す%はクラスター内%)。

該当する接触経験のないクラスターは主にクラスター1(n=595)として現れた。次いで、クラスター2(n=167)はQ5x1「公共窓口」とQ5x2「仕事現場」が強調され、またQ5x6「場所とわず携帯できる形で」も現れているため、「公共空間」と名付けた。クラスター3(n=228)はQ5x4「趣味のコミュニティー」にやや反応はあるが、特にQ5x3「私生活空間」の傾向が強く現れているため、「私生活空間」と命名する。 次にAIの社会的役割の想定に関して検討すると、クラスター1(n=545)は特徴がなく、クラスター2(n=283)とクラスター3(n=162)を表2のように解釈できることが分かる。

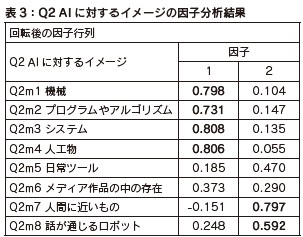

クラスター3「娯楽的サービス」はクラスター2「補助型の道具」の役割よりインフォーマルで、人との関係性をうかがわせる面が表れているが、道具性も同じく強調されている。一方で、全体の反応を見るとAIの他者性・主体性がより強調される項目であるQ6x3「協働に何かを創作・制作する仲間」、Q6x4「お互いに刺激し合う競争相手」、Q6x7「コンパニオンとして生活を共にする仲間」に対する期待は弱く、AIが「共創・共生の他者」として人間社会に組み込まれるクラスターとして独立した役割を持つまでには認識の上で分化していないのではないかと思われる2。 全体を通じて回答者のおよそ3分の1がAIへの接触経験を認識しておらず、したがってその利用場面や社会的役割についてもイメージしにくいことには留意が必要である。2024年1月の時点になっても日本国内でChatGPTに関して「聞いたことがない」人々が35.7%いる(NTTドコモモバイル社会研究所の報告3 )ことに鑑みると、日本人の3分の1はAIとの接点を(明示的に)持たないまま過ごしているのかもしれない。 日常生活における具体的な接触経験、利用場面の想定や役割の想定以外に、人工知能という存在に対する全体的な認識についても調査した。人々のイメージを把握するために、Q2「あなたにとってAIはどのような存在だというイメージですか」という質問項目を用い、8項目について5件法(「全く当てはまらない」~「大いに当てはまる」)で回答を得た。これらのデータに対して、AIに対するイメージの構造を探索的に明らかにする目的で、因子分析を実施した。 AIのイメージ(Q2)に対して最尤法(Varimax回転)を用いた因子分析を行った結果、累積寄与率50.9%で2因子が抽出された。回転後の因子負荷量(表3)を見ると、Q2m1「機械」、Q2m2「プログラムやアルゴリズム」、Q2m3「システム」とQ2m4「人工物」は第1因子に負荷(0.731~0.808)が高いため、この因子は道具性が強く「道具的人工システムという認識」の因子だと解釈する。Q2m7「人間に近いもの」・Q2m8「話が通じるロボット」は第2因子に負荷(0.592, 0.797)が高く、この因子は「人間に近い存在・ロボット的他者」と名付ける。この結果は、AIに対する認識が「人工物としての機能性や道具性」と「擬人的他者としての親近性」という2軸によって構造化されていることを推測させる。

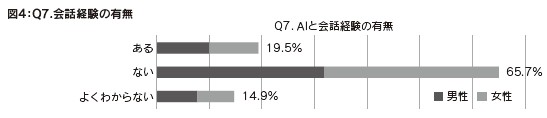

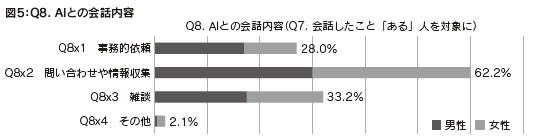

3.2.AIと会話すること AIの日常接触・利用(Q1)の調査結果にも表れているように、SiriやAlexaに代表されるチャットボットやAI音声アシスタントは、スマートフォンやスマートスピーカーといったデバイスを介して、一般消費者が日常的に利用する最も身近なAI技術の一つである。こうした対話的なインタラクションにおいて、AIは単なる内部機能としての「ブラックボックス」的存在にとどまらず、利用者にとって「話しかけられる相手」として直接的に認識されやすい。そのため、AIとの心理的な関係性や親密性を検討する上で、AIとの会話経験は有効かつ重要な分析対象となる。この点に注目して、本調査ではAIとの会話経験の有無を確認した上で、会話経験のあるユーザーに対して、会話の内容を尋ねた。 調査の結果、AIとの会話経験が「ある」と回答したのは全体の19.5%(n=193)であり、「ない」と回答した人は全体の65.7%(n=650)と過半数を占めた。(図4) 会話経験のある回答者に対して、会話内容について複数回答形式で尋ねたところ、「問い合わせや情報収集」が最も多く62.2%、次いで「雑談」33.2%、「事務的な依頼」28.0%であった。(図5)

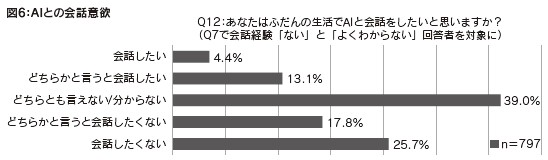

次に、AIとの会話経験が「ある」と回答した人以外の回答者(n=797)に対してAIとの会話意欲について(Q12)調査した。その結果、「会話したい」および「どちらかというと会話したい」と回答した人は17.4%にとどまり、一方で「どちらかというと会話したくない」および「会話したくない」と回答した人は43.5%と、会話に消極的な回答者が多数を占めた。(図6)

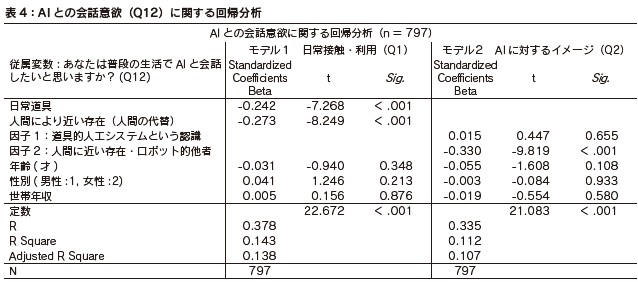

会話意欲に関する予測要因を探求するために、まず日常的な接触経験に注目し、Q1項目に基づいて作成した「AIの日常接触・利用」に関する尺度を用いて重回帰分析を行なった(表4左)。なお、従属変数である会話意欲(Q12)は「会話したい」を1、「会話したくない」を5とする5件法で数値化されているため、回帰係数が負である場合は、会話意欲が高いことを意味する。 分析の結果、「日常道具」「人間により近い存在(人間の代替)」の二つの尺度は、AIとの会話意欲を有意に予測することが示された(いずれも p <.001)。特に「人間により近い存在」との接触の効果は注目に値しよう(β= -0.273)。つまり、日常生活において擬人化の度合いが高いAIエージェントに親しみを感じている人ほど、AIとの会話に対して積極的な意欲を示す傾向が見出された。 次にAIに対するイメージと会話意欲の関係性を見るために、Q2の分析で得られた「人工物としての機能性や道具性」と「擬人的他者としての親近性」の二つの軸の因子スコアを独立変数、AIとの会話意欲を従属変数とした重回帰分析を行った(表4右)。

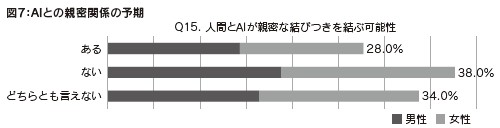

モデル全体は有意であり、AIとの会話意欲に対する予測力が認められた。決定係数は R² =.112(調整済 R² = .107)であり、AIとの会話意欲の約11.2%を説明した。回帰係数の検討からは第2因子「人間に近い存在・ロボット的他者」が明瞭な負の効果(β= –.330, p < .001)を示した。一方、第1因子「道具的人工システムという認識」の効果は有意ではなかった。接触・利用の経験と一貫して、AIに対して「擬人的他者としての親近性」を強く認識している利用者の会話意欲が高いことを推測できる。 二つのモデルいずれも、AIとの会話意欲はAIエージェントの擬人化度合いと強く結びついていることが示唆された。 3.3.AIとの親密関係 前節では、AIに対する認識や接触経験と、AIとの会話意欲との関連性について検討した。その結果、「道具性」としての側面よりも、「人間に親しみやすい擬人化された他者」としての側面が、会話というインタラクティブな行為への意欲に対して強く関連していることが示された。 では、これまで人間同士に限られていた「会話」の相手がAIとなることで、人とAIとの関係性にはどのような変化や可能性が生じるのだろうか。本節では、回答者の持つAIとの親密関係に対する予期に関する構造的要因を探索的に検討する。 人工知能が情報技術(ある種の道具)として利用されるだけではなく、人間と親密な関係を結ぶ可能性(Q15)について尋ねたところ、「ある」と回答した割合が28.0%、「ない」が38.0%、「どちらとも言えない」が34.0%となった。(図7)

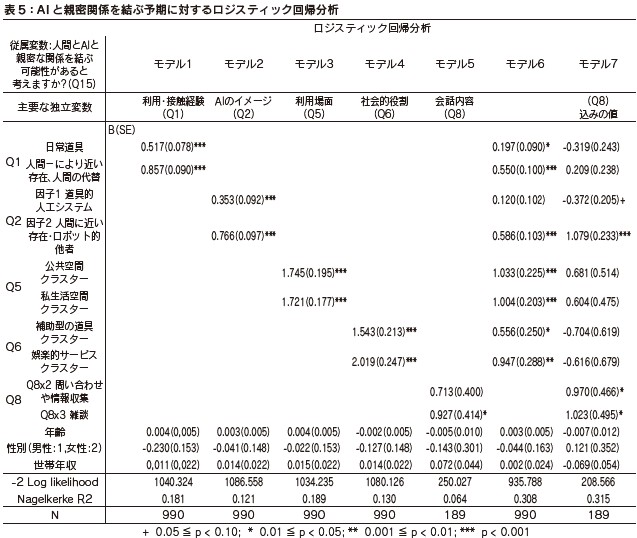

AIと親密な関係を築くことに対してポジティブな態度を抱くことが、これまで検討してきたAIに対するイメージや接触経験などの要因とどのような関連を持つのかを明らかにするため、ロジスティック回帰分析を実施した。Q15の回答に基づき、「ある」と回答した者には1、それ以外の回答者には0を付与したダミー変数を従属変数とし、各予測変数の影響を検証した。(表5)

日常生活の利用・接触経験に関して、Q1に基づく二つの変数「日常道具」(B=0.517, p <.001)と「人間により近い存在、人間の代替」(B=0.857, p < .001)のいずれも、AIと親密な関係を築くことに対する予期を有意に予測していた(モデル1)。後者は、モデル6で主要独立変数を同時投入しても統計的な有意性を落とさずロバストであり、人間に近い特徴を持つAIエージェントとの接触経験の方が、AIとの親密関係を築けると信じる傾向をより強く予測できることが示唆された。 AIに対するイメージ(Q2)の因子分析により抽出された2つの因子を独立変数として投入したロジスティック回帰分析(モデル2)の結果、いずれの因子もAIと親密な関係を築くことに対する予期を有意に予測していた。モデル2の説明力はやや限定的であり、Nagelkerke R²は0.121にとどまったが、特にAIを道具的な人工システムではなく、人間に近い存在やロボット的な他者として認識する傾向(B=0.766, p < .001)が、親密関係を築けるという認識に対してより強い正の関連性を持つことを示していた(モデル6で主要独立変数を同時投入してもこの認識は統計的に有意であった)。 また、利用場面(Q5)と社会的役割(Q6)の三つのクラスターそれぞれについてダミー変数を作成し、特徴のある四つのクラスタを独立変数とする分析(モデル3と4)を行なった。公共空間クラスターと私生活空間クラスターを投入した結果、いずれも有効な予測因子であった。特徴のないクラスター1に対して公共空間クラスター(B=1.396, p < .001)も私生活空間クラスター(B=1.351, p < .001)もともに有効な予測要因であった。社会的役割(モデル4)に関しても同様に、いずれも有意な予測因子であり、基準としてのクラスター1に対して「娯楽的サービス」クラスター(B=1.273, p < .001)は「補助的道具」クラスター(B=0.907, p < .001)とほぼ同様の予測力を有している。ただし、モデル6に見るように有効な独立変数を同時に投入してみると、有意性の度合いからみて、社会生活においてAIに娯楽的な役割を想定する人の方がAIとの親密な関係の形成に対してより肯定的な見通しを持っていると読み取ることができるかもしれない。 最後に、会話内容が親密関係の予期に与える影響を確認するため、AIとの会話経験がある回答者に限り、その会話内容(Q8)を独立変数とした分析を行った(n=189)。その結果、「雑談」(Q8x3)のみが有意な予測因子であり(B=0.927,p =.025)、「問い合わせや情報収集」や「事務的依頼」といった実務的な会話に比べて、「雑談」の経験がある回答者の方が、AIとの親密な関係性を築く可能性についてより肯定的な予期を抱いていることが示された。 4.考察 本研究では、AIに対する日本人のイメージを調査し、計量的な分析を行った。AIに関する概括的なイメージ、日常生活における接触経験、さらに利用場面や社会的役割の想定に関する分析を通じて、AIに対する認識は主に「人工物としての機能性・道具性」と「擬人的な他者としての親近性」という二つの軸に左右されていることが示唆された。AIに対しては「補助型の道具」や「娯楽的サービス」としての道具性の強い役割が想定される一方で、人間と協働しながら「共生」していく主体的な他者としての想定はまだ明確に現れていないようである。 また、AIと直接「会話」するという行為に関する質問からは、全体のおよそ6割の回答者が明確な会話経験を有していないことが判明した。非会話経験者の会話意欲(Q12)に関する回帰分析の結果、日常生活におけるAIとの接触が深まることで、会話意欲にポジティブな影響を与える可能性が示された。さらに、AIをより人間に近い存在として認識する傾向も、会話意欲を有意に予測しており、「擬人化の度合い」も、人間がAIとインタラクティブな関係を築こうとする態度を予測するうえで重要な要因となることが明らかになった。 最後に、AIとの親密な関係性を築くことに対する予期(Q15)に関するロジスティック回帰分析の結果から、AIの全体的なイメージにおいて道具的な側面に重点を置く利用者よりも、人間に近い他者としてAIを捉える傾向や、実際の接触経験の増加の方が、AIとの親密な関係性に対する予期にポジティブに寄与することが明らかとなった。一方で、利用場面や社会的役割の想定については、想定の具体性がAIの普及状況に大きく依存していると考えられ、本調査の時点ではこれらに関する認識が明確に定着しているとは言いがたく、親密性との関連性も依然として不明確な部分が残されている。しかし、接触経験のなかでも注目すべき点は、AIとの会話経験の中でも「雑談」の経験が、親密関係を予測する上で有意な因子であったことである。これは、インタラクティブかつ非目的的なやりとりを通じて、AIが他者として認識されやすくなる可能性を示唆している。 本研究で実施したウェブ調査は、ChatGPTが一般的に利用されるわずか前に行われたものであり、そのため当時の実態およびAIに対するイメージに限定された内容となっている。しかし、分析の結果から「会話」がAIとの関係性に重要な影響を及ぼしうることが示唆されたことを踏まえると、今後は同様の枠組みに基づく再調査を通じて、ChatGPT普及前後における認識や態度の変化を検討する意義があるといえる。特に、知能的な人工エージェントとのインタラクションを通じて、従来の人間中心のコミュニケーションモデルがどのように更新されうるのか、あるいは人間が自己と類似した人工的存在を媒介として、自己認識をいかに深めていくのかといった点について、今後さらに議論を深めていく必要がある。 注釈 1 「AIオペレータ」についての情報は、ヤマト運輸株式会社の公式サイトを参照。https://www.kuronekoyamato.co.jp/ytc/customer/send/members/shuka/artificialintelligence.htm(2025年4月6日アクセス)。 2 クラスター数を増しても分化したクラスターは表れなかった。 3 モバイル社会研究所(2024)「レポート 学生の4割超・教職員の約3割がChatGPT利用」 https://www.moba-ken.jp/project/service/20240610.html(2025年4月7日アクセス)。 参考文献 モバイル社会研究所(2024) 「レポート 学生の4割超・教職員の約3割がChatGPT利用」 https://www.moba-ken.jp/project/service/20240610.html |